AI-RAN tornou-se um dos temas mais discutidos no setor de telecomunicações. Algumas pessoas o veem como a próxima etapa da evolução das redes sem fio, enquanto outras consideram que o conceito pode estar supervalorizado antes que o modelo de negócios, a estrutura de custos e a arquitetura técnica sejam totalmente comprovados. Para entendê-lo corretamente, é preciso ir além do termo de marketing e observar como redes de acesso rádio, computação de IA, arquitetura de chips, edge computing e estratégia 6G estão convergindo.

AI-RAN significa Artificial Intelligence Radio Access Network. Em termos simples, é a aplicação de tecnologias de IA à rede de acesso rádio, ou a construção de uma rede sem fio capaz de processar cargas de comunicação e cargas de IA de forma integrada. Não é apenas colocar software de IA em uma estação-base; o conceito mais profundo é transformar a estação-base de um nó de comunicação de propósito único em um nó inteligente de computação de borda.

Este artigo explica AI-RAN sob uma perspectiva de solução e engenharia. Ele cobre a evolução da RAN tradicional para Open RAN, o papel de CPU, GPU, FPGA e ASIC, o significado de AI for RAN, AI and RAN e AI on RAN, o progresso industrial liderado por NVIDIA, SoftBank, Nokia, Ericsson, Huawei e ZTE, e os principais desafios de implantação que as operadoras precisam considerar.

Entendendo RAN antes de entender AI-RAN

RAN significa Radio Access Network. Em uma rede móvel, há três partes principais: rede central, rede de transporte e rede de acesso rádio. A RAN é a primeira camada que conecta smartphones, terminais industriais, sensores, veículos e dispositivos IoT à rede da operadora.

Na era 4G, uma estação-base normalmente era formada por antenas, unidades de rádio remotas chamadas RRU, unidades de banda-base chamadas BBU e os enlaces entre elas. A antena e a unidade de rádio transmitiam e recebiam sinais, enquanto a BBU processava modulação, demodulação, codificação, decodificação, estimativa de canal e agendamento de recursos.

Na era 5G, a arquitetura mudou. A antena e a RRU foram mais integradas e evoluíram para a AAU, ou Active Antenna Unit. Ao mesmo tempo, as funções da BBU foram separadas em CU e DU. A CU trata principalmente funções não tempo real, enquanto a DU trata o processamento de banda-base em tempo real. Essa divisão trouxe flexibilidade, mas também maior complexidade.

Por que a RAN é difícil de abrir e virtualizar

A rede central foi mais fácil de virtualizar porque muitas tarefas envolvem roteamento, comutação, controle de sessão e gestão de serviços. Isso levou ao avanço da NFV. A RAN é mais difícil porque a banda-base exige latência baixa, densidade de computação, precisão de tempo e desempenho em tempo real.

Estações-base tradicionais eram sistemas fechados de fornecedores de equipamentos de telecom, com chips ASIC personalizados e software proprietário. Esse modelo de “caixa-preta” era eficiente, pois ASICs são desenhados para cargas fixas e podem oferecer alta densidade de computação, baixo consumo e latência estável para banda-base RAN.

Depois, as operadoras impulsionaram arquiteturas mais abertas e white-box, buscando desacoplar hardware e software, padronizar interfaces e permitir que servidores e chips de uso geral suportem cargas de telecom. Essa direção gerou C-RAN, O-RAN, vRAN, xRAN e Open RAN.

De C-RAN para Open RAN

Na era 4G, a China Mobile promoveu C-RAN, ou Centralized RAN. A ideia era mover várias BBUs distribuídas para uma sala centralizada e construir um pool de banda-base, que processa cargas de forma centralizada e distribui sinais às unidades de rádio remotas por fibra.

Open RAN foi além. Sua ideia principal é arquitetura modular com interfaces padronizadas. RU, DU e CU podem vir de diferentes fornecedores quando as interfaces são compatíveis. O software de banda-base também pode ser separado dos chips dedicados e executado em plataformas x86 ou ARM.

Mas Open RAN também expôs um problema de engenharia: CPUs de uso geral são flexíveis, porém podem consumir mais energia, ter menor eficiência e apresentar latência menos estável que sistemas ASIC dedicados. Por isso muitos projetos Open RAN enfrentaram dificuldades em operação comercial de grande escala. RAN é problema de software, mas também de tempo real e eficiência energética.

Por que a GPU entra na discussão de RAN

A lógica do AI-RAN começa na arquitetura de chips. Em telecom e computação, os principais chips são CPU, GPU, FPGA e ASIC. CPU representa computação geral; ASIC representa hardware especializado de telecom; FPGA oferece flexibilidade para protótipos e cenários específicos; GPU é a nova força por trás do AI-RAN.

A estratégia da NVIDIA é levar computação GPU às estações-base. O objetivo não é apenas usar GPUs para banda-base, mas também executar modelos de IA próximos à borda da rede. Se uma estação-base processa cargas RAN e cargas de IA, ela pode se tornar uma nova infraestrutura de IA de borda.

Isso importa porque o mercado global de equipamentos de telecom é enorme, com gasto anual superior a 100 bilhões de USD. Se GPUs se tornarem parte da arquitetura de estações-base, a rede de telecom pode virar um grande novo mercado de computação.

AI-RAN é mais que uma estação-base com GPU

A ideia mais importante não é simplesmente “instalar GPUs em estações-base”. A visão estratégica é transformar a estação-base em um servidor de IA de borda de baixa latência com conectividade 5G e futura 6G. Nesse modelo, ela processa sinais sem fio e executa inferência de IA para usuários, dispositivos, veículos, câmeras, robôs e sistemas industriais próximos.

A IA também pode melhorar a própria RAN por meio de previsão de estado do canal, identificação dinâmica de interferência multiusuário, otimização de feixes de ondas milimétricas, previsão de tráfego, economia de energia e agendamento de recursos rádio. Isso pode melhorar desempenho e reduzir complexidade operacional.

Do ponto de vista de edge computing, AI-RAN fica entre a nuvem e o dispositivo. A nuvem tem grande potência, mas está distante; os terminais estão próximos, mas são limitados; as estações-base ficam no meio, mais próximas que a nuvem e mais fortes que muitos terminais, sendo locais naturais para IA de baixa latência.

As três direções técnicas de AI-RAN

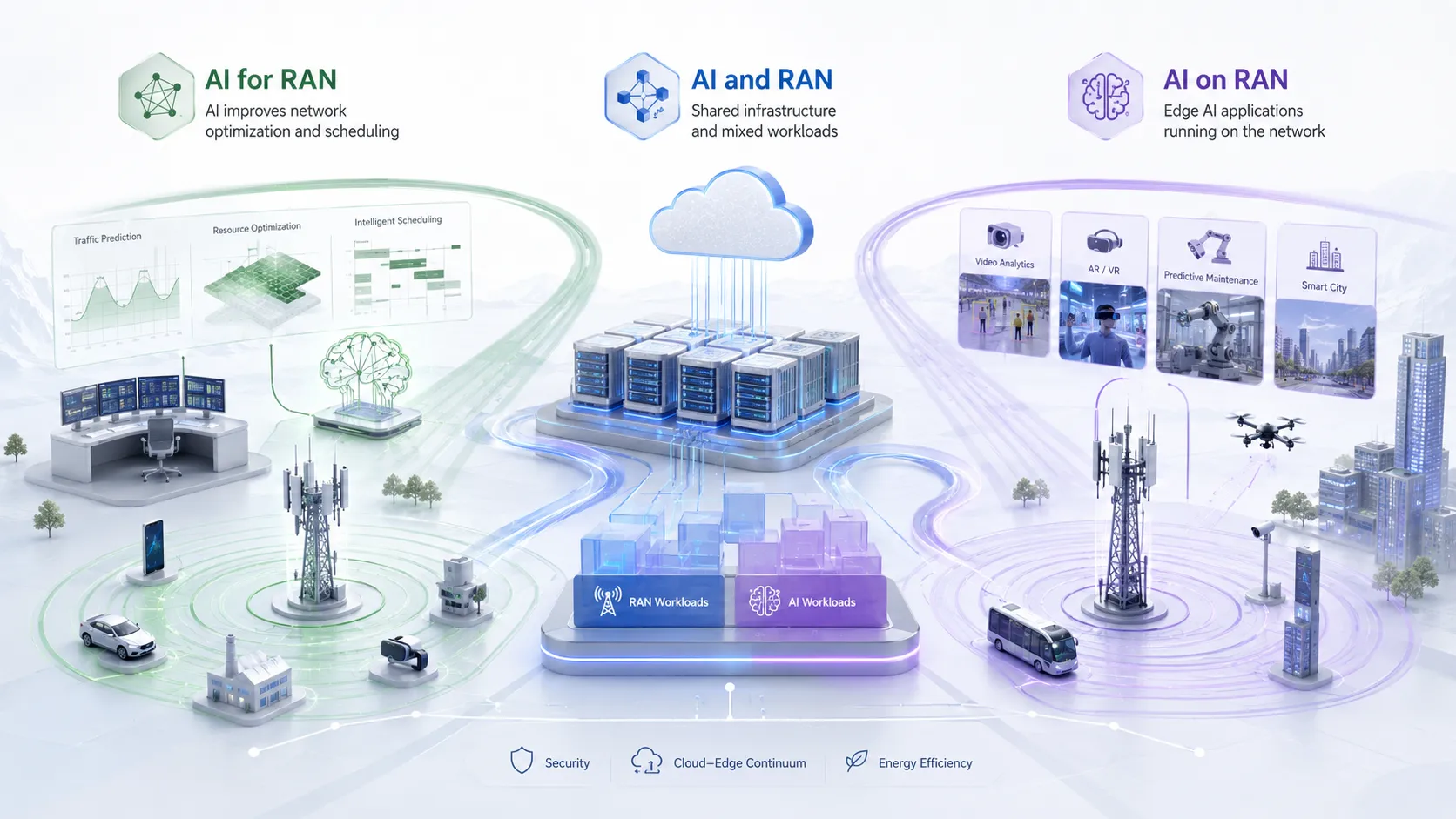

A AI-RAN Alliance divide a pesquisa em AI for RAN, AI and RAN e AI on RAN. As direções são diferentes, mas conectadas.

AI for RAN

AI for RAN usa IA para melhorar a rede de acesso rádio, com previsão de tráfego, agendamento inteligente, economia de energia, detecção de falhas, gestão de interferência e otimização de beamforming.

É a direção mais direta e prática, pois melhora a rede em si e pode reduzir custos operacionais.

AI and RAN

AI and RAN executa funções de comunicação e de IA na mesma infraestrutura. O desafio é isolar, agendar, priorizar e equilibrar cargas RAN e IA sem prejudicar o desempenho em tempo real.

Essa direção define se AI-RAN pode ser uma plataforma econômica, pois o mesmo hardware pode aumentar a utilização de recursos ao suportar rede e serviços de IA.

AI on RAN

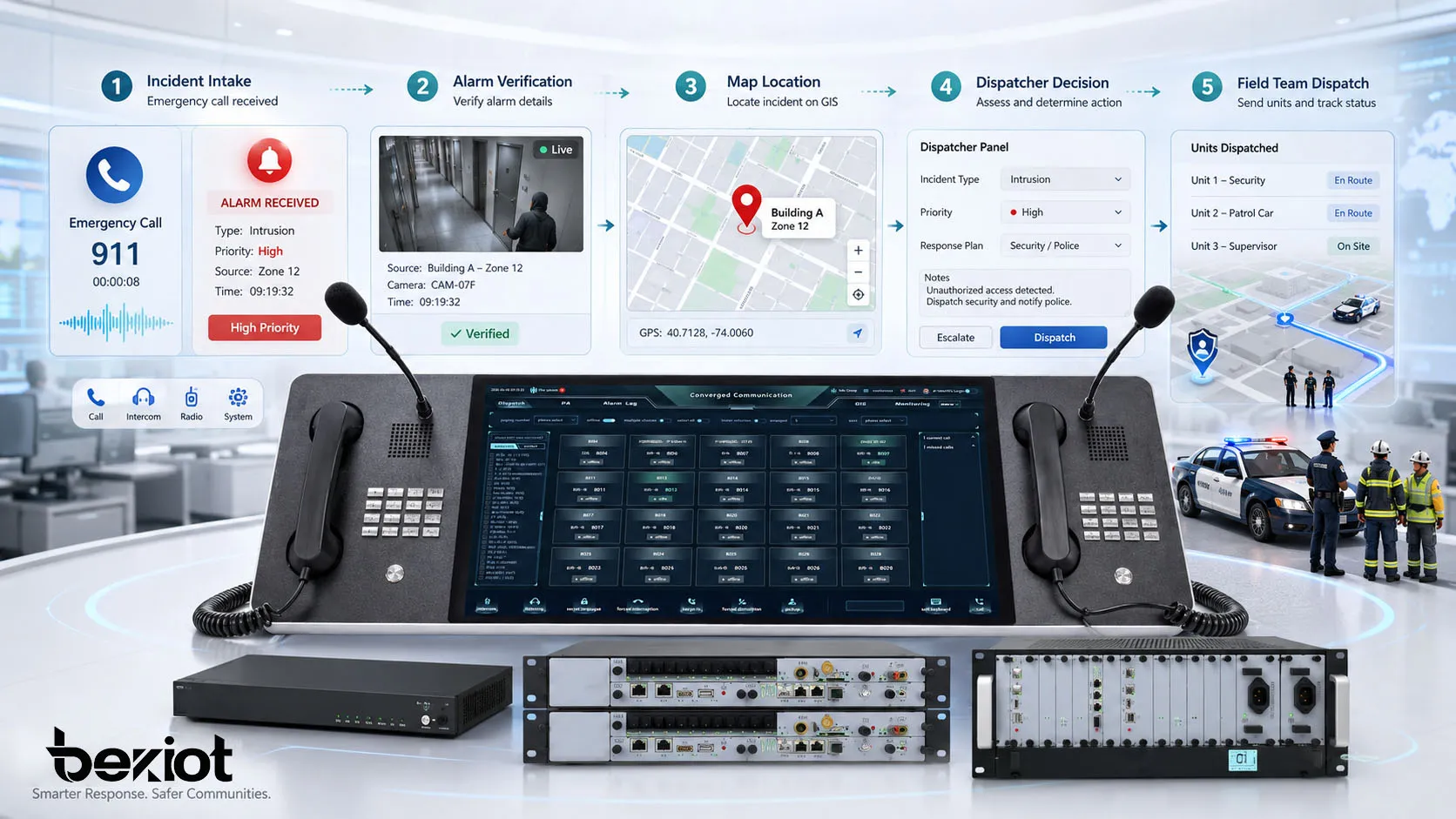

AI on RAN usa a infraestrutura RAN para aplicações externas de IA, como análise de vídeo, posicionamento industrial, sistemas autônomos, cidades inteligentes, veículos conectados, AR/VR e serviços de baixa latência.

É o ponto mais próximo da visão 6G, em que redes futuras poderão transmitir, sentir, computar, analisar e coordenar inteligência na borda.

Progresso industrial do AI-RAN

Em fevereiro de 2024, no MWC Barcelona, NVIDIA, SoftBank, Ericsson, Nokia, Microsoft e outros membros fundadores lançaram a AI-RAN Alliance. Ela começou com 11 fundadores e rapidamente passou de 100 operadoras, fornecedores e parceiros.

Em novembro de 2024, NVIDIA e SoftBank anunciaram um teste descrito como a primeira rede AI-RAN capaz de processar cargas de IA e 5G. Em 2025, a NVIDIA investiu 1 bilhão de USD na Nokia, tornando-se uma das maiores acionistas e fortalecendo cooperação em 6G RAN e AI-RAN.

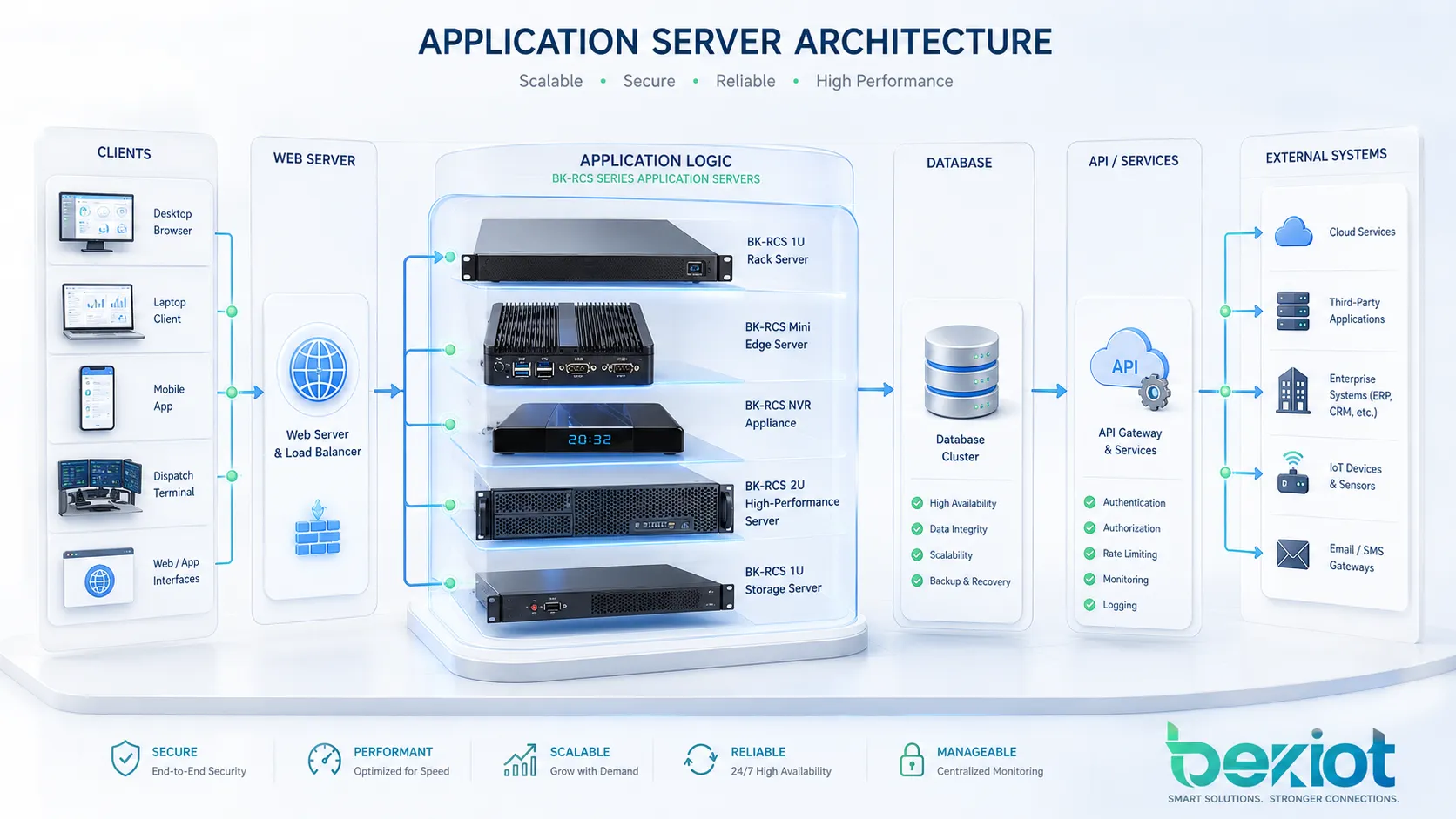

A NVIDIA também apresentou Aerial RAN Computer Pro, ou ARC-Pro, e a plataforma AI Aerial, integrando GB200, BlueField-3, Spectrum-X e bibliotecas CUDA-X para casos telecom.

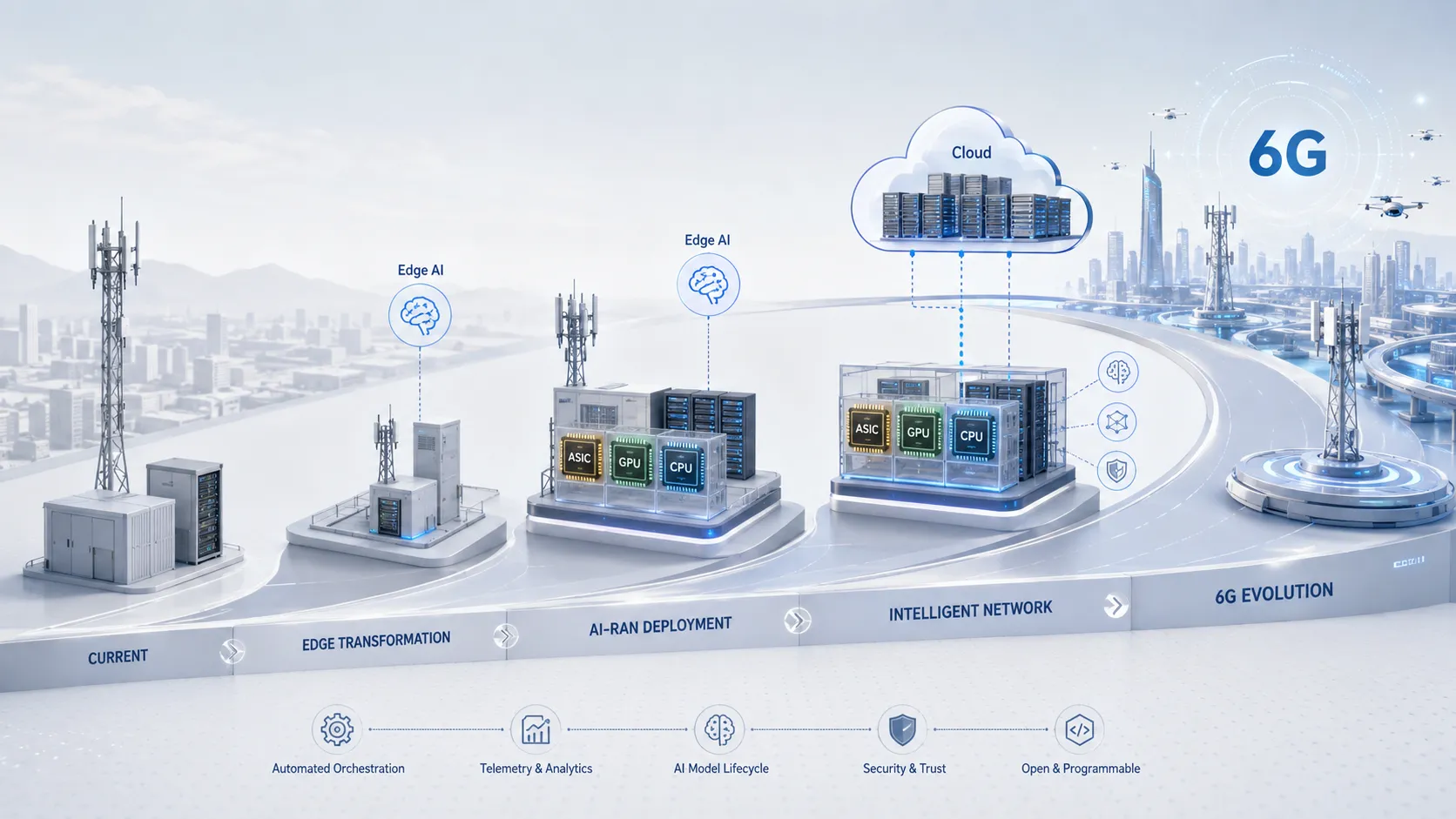

Depois, NVIDIA e parceiros promoveram o stack “All-American AI-RAN”, para alocação dinâmica de recursos GPU em vRAN, aplicações de IA e pesquisa 6G. Em março de 2026, a visão AI Grid posicionou AI-RAN como camada-chave de rede e computação de borda, com nuvem distribuída e orquestração.

Dois caminhos industriais: aderir ou construir de forma independente

O primeiro caminho é adotar totalmente a arquitetura AI-RAN baseada em GPU. Operadoras como SoftBank e AT&T buscam inteligência de rede, redução de OPEX, novos serviços e posicionamento para 6G. Algumas estimativas apontam redução de OPEX superior a 30% em certos cenários.

A Nokia é visível nesse caminho com o software anyRAN integrado a plataformas NVIDIA GPU AI RAN. Em março de 2026, anunciou testes com T-Mobile US, Telkom Indonesia e SoftBank.

O segundo caminho é a exploração independente. Fornecedores e operadoras aceitam que a IA mudará a comunicação, mas querem evitar dependência de um único ecossistema GPU. Ericsson testou software RAN em plataformas NVIDIA AI e também integrou acelerador neural programável em seus chips Ericsson Silicon, aproximando a inferência de AAU e RRU.

Huawei e ZTE também seguem rotas próprias, com AI-Centric Network e AIR MAX. Isso mostra que AI-RAN não é uma solução de fornecedor único, mas uma direção ampla com várias rotas técnicas.

Por que as operadoras têm interesse e preocupação

AI-RAN pode ajudar operadoras a sair do papel de “tubo burro”. Se estações-base se tornarem nós programáveis de IA na borda, elas podem criar serviços de inferência de baixa latência, aplicações industriais, exposição de dados, redes privadas e edge computing.

Algumas operadoras falam em migrar de operação de tráfego para “operação de tokens”, ou de provedoras de comunicação para provedoras de computação. AI-RAN combina conectividade rádio com computação de IA de borda.

A preocupação é o lock-in: se banda-base e inferência ficarem presas a uma plataforma GPU, o controle da arquitetura pode migrar para esse ecossistema, criando riscos de soberania, cadeia de suprimentos, transparência de custos e negociação de longo prazo.

Desafios de implantação de AI-RAN

O primeiro desafio é custo. CAPEX pode ser alto por aceleradores de IA, servidores, rede e upgrades de sites; OPEX também pode subir por consumo elétrico, resfriamento, manutenção e novos processos.

O segundo desafio é o modelo de negócios: como medir, precificar, vender e operar computação de IA de borda? Como cloud, fatias de rede, serviços industriais ou nova categoria?

O terceiro é padronização. 3GPP lidera padrões telecom, enquanto AI-RAN Alliance impulsiona esse campo. Ainda faltam estruturas unificadas para semântica de dados, interfaces de modelos, orquestração, agendamento e responsabilidade comercial.

O quarto é maturidade do ecossistema. Fabricantes de chips, fornecedores, operadoras, nuvens, terminais, desenvolvedores e provedores de modelos precisam escolher rotas técnicas e evitar apostas erradas.

Por que computação heterogênea pode ser a resposta real

A arquitetura final provavelmente não será apenas GPU. A direção realista é combinar ASIC + GPU + CPU e, em alguns cenários, FPGA.

ASIC é eficiente para cargas fixas de telecom; CPU oferece controle flexível; GPU é forte em IA paralela e cargas RAN aceleradas; FPGA permite aceleração programável especializada.

Essa arquitetura híbrida evita dependência de uma rota única e permite implantação gradual em otimização de rede, vídeo na borda, posicionamento industrial, redes privadas e pesquisa 6G.

Arquitetura recomendada de solução AI-RAN

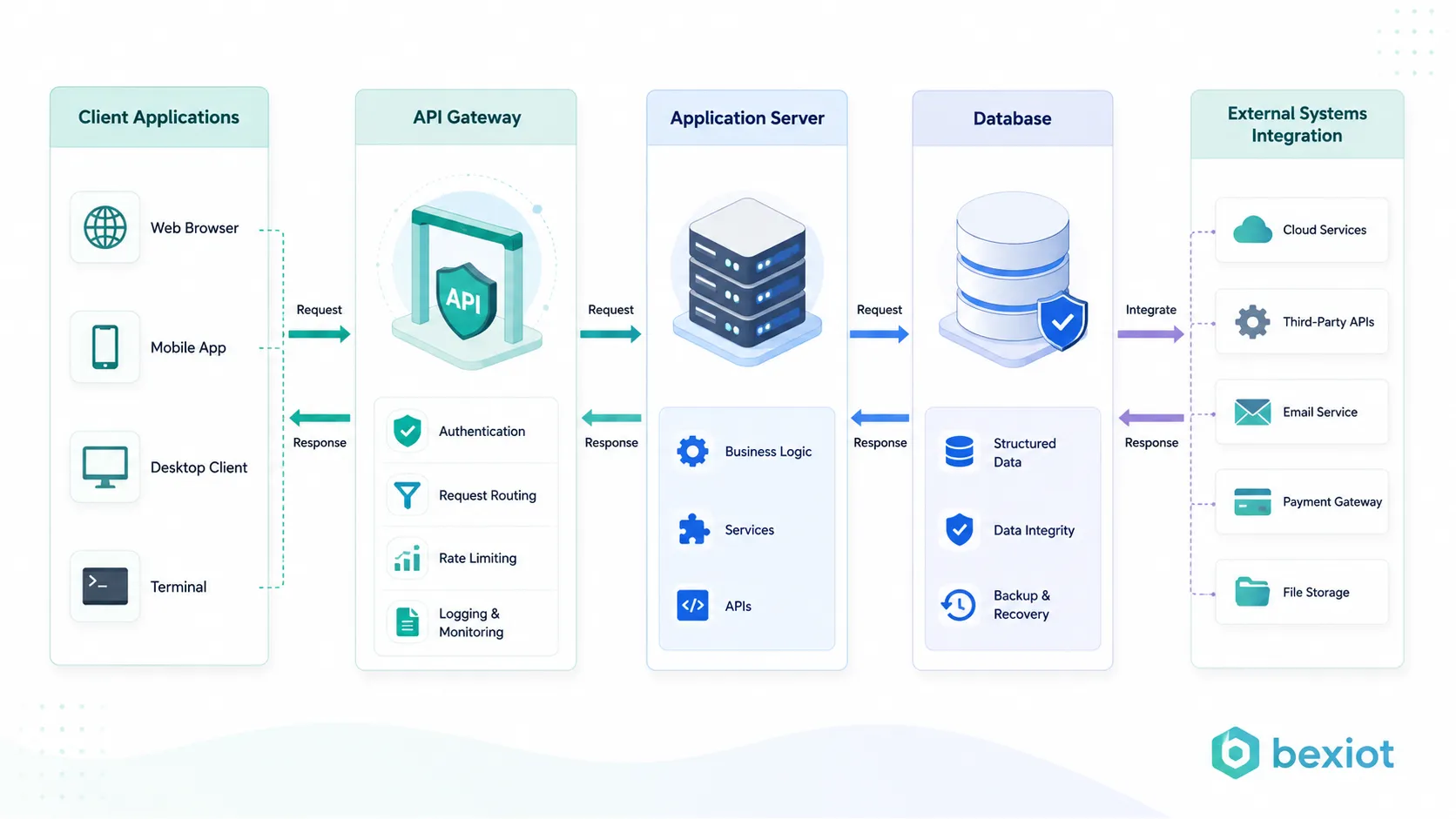

Uma solução prática deve ser em camadas: rádio com RU, AAU, DU e CU; computação com ASIC, CPU, GPU e talvez FPGA; IA com runtime de modelos, inferência, dados e otimização; orquestração para agendamento, exposição de serviços, monitoramento e ciclo de vida.

Cargas telecom devem manter desempenho determinístico. Cargas de IA podem ser agendadas por prioridade, capacidade e latência. RAN em tempo real deve ter prioridade sobre inferência não crítica; vídeo, posicionamento e controle de baixa latência seguem SLA.

Também é necessária uma camada de segurança e governança: privacidade de dados, segurança de modelos, acesso, auditoria, isolamento e recuperação de falhas, pois AI-RAN conecta infraestrutura de rede e aplicações de IA.

Casos de uso de AI-RAN

Otimização de rede

IA pode prever tráfego, identificar interferência, otimizar recursos rádio, economizar energia e ajustar automaticamente a rede.

Análise de vídeo na borda

Estações com IA de borda processam vídeo para segurança pública, monitoramento industrial, tráfego e campus inteligente, reduzindo tráfego para a nuvem.

Redes privadas industriais

Em fábricas, portos, minas, energia e logística, AI-RAN combina 5G privado e inferência local para visão de máquina, robôs, segurança, inspeção e monitoramento de baixa latência.

Pesquisa 6G e redes nativas de IA

AI-RAN pode ser base para 6G, integrando comunicação, sensoriamento, computação e inteligência.

Conclusão

AI-RAN conecta evolução RAN, IA, infraestrutura de borda, Open RAN, aceleração GPU e estratégia 6G. O objetivo é transformar a rede de acesso rádio em uma plataforma inteligente de edge computing.

Mas ainda é uma tecnologia inicial. Desde 2024 houve rápido progresso, porém sucesso comercial em grande escala não é garantido. CAPEX, OPEX, energia, lock-in, modelo de negócios, padrões e ecossistema seguem desafiadores.

O futuro mais provável é computação heterogênea, implantação faseada, interfaces abertas, validação comercial e evolução para 6G. AI-RAN pode ser central, mas precisa de tempo, implantação real e prova de mercado.

FAQ

O que significa AI-RAN?

Significa Artificial Intelligence Radio Access Network: aplicar IA à rede de acesso rádio e integrar cargas de comunicação e computação de IA.

AI-RAN é apenas colocar GPUs em estações-base?

Não. GPUs são importantes, mas AI-RAN inclui otimização com IA, infraestrutura compartilhada e uso da RAN como plataforma de IA de borda.

O que são AI for RAN, AI and RAN e AI on RAN?

AI for RAN melhora a rede; AI and RAN compartilha infraestrutura; AI on RAN usa a RAN como plataforma de aplicações de IA.

Por que AI-RAN é importante para 6G?

6G deve integrar comunicação, sensoriamento, computação e inteligência; AI-RAN oferece uma base de borda e rede nativa de IA.

Quais são os maiores desafios?

CAPEX, OPEX, energia, lock-in, modelo de negócios incerto, falta de padrões unificados e ecossistema imaturo.

Qual arquitetura de computação é mais provável?

Uma arquitetura heterogênea com ASIC, GPU, CPU e às vezes FPGA para equilibrar desempenho, eficiência, custo, flexibilidade e controle.